【AI Security Conference】日本からAIセーフティのグローバルスタンダードを打ち立てる

2026年1月27日、ファインディ株式会社が主催するイベント「AI Security Conference」が野村コンファレンスプラザ日本橋で開催されました。

本記事では、株式会社Elith 代表取締役CEO兼CTOの井上 顧基さんによるセッション「日本からAIセーフティのグローバルスタンダードを打ち立てる」の内容をお届けします。

AI技術の急速な進化とともに、その影に潜むセキュリティリスクへの対策が急務となっています。AIセーフティの最前線を走るトップランナーの立場から、AI開発において「加害者」にも「被害者」にもならないための実践的な知見が語られました。

■プロフィール

井上 顧基

株式会社Elith

代表取締役CEO兼CTO

日本からAIセーフティのグローバルスタンダードを打ち立てる

本日はよろしくお願いいたします。株式会社Elithの井上です。今回紹介させていただくのは、弊社で開発している「GENFLUX(ジェンフラックス)」というプロダクトです。

この名前は「Generative(生成)」と「Flux(流動・変化)」を組み合わせた造語で、激しく変化する生成AIの流れをしっかりと掴み取りながら、その安全性を確保するという想いを込めています。

まずみなさんに伺いたいのですが、「AIセーフティ」という言葉をご存知でしょうか。会場を見渡すと、まだそれほど浸透していないなという印象を受けますが、これはAIが安全性を保った状態にあるかどうかを指す、今まさにグローバルで議論が加速している重要なキーワードです。

最近では内閣府直轄の組織として「AISI(AIセーフティ・インスティテュート)」が設立されるなど、国を挙げた動きも活発になっています。

私たちが展開しているElithという会社は、東大・松尾研発のスタートアップで、現在4期目を迎えています。日本を拠点にしながらもグローバルな視点での研究開発に力を入れており、実はアジア圏の台湾やモンゴルなどでは既にプロダクトが導入され、海外での売上が先行しているような状況です。

世界最前線、サンフランシスコで見たAIセーフティの現実

製品の具体的な紹介に入る前に、私たちがセキュリティの領域でどのような活動をしてきたかをお話しさせてください。

昨年12月に、サンフランシスコで開催された「Open Safeguard Hackathon」に日本人として唯一参加してきました。これはOpenAIやHugging Faceが共催したハッカソンで、世界のトップエンジニアたちが集まる場所です。そこで私たちは、OpenAIのセーフガードモデルに対して、実に1800個ほどの脆弱性を発見しました。

いま、西海岸のサンフランシスコは「セレブレムバレー」とも呼ばれ、OpenAIやAnthropicといった巨大なAI企業が本社を構え、文字通り世界の最前線となっています。ただ、実際に現地に行ってみると、AIの進化の華やかさとは裏腹に、歩いているとホームレスの方に襲われそうになるほど治安が悪い場所もあり、非常にヒヤヒヤする思いをしました。

また研究面では、世界最高峰の国際学会であるICCVに、自動運転領域のAIセーフティに関する論文が採択されました。採択率は24%という狭き門で、1年間真面目に研究を続けているプロフェッショナルが出しても4人に1人しか通らないような難しい世界です。こうした高い研究力を、ただの理論に留めず社会実装に繋げているのが私たちの強みです。

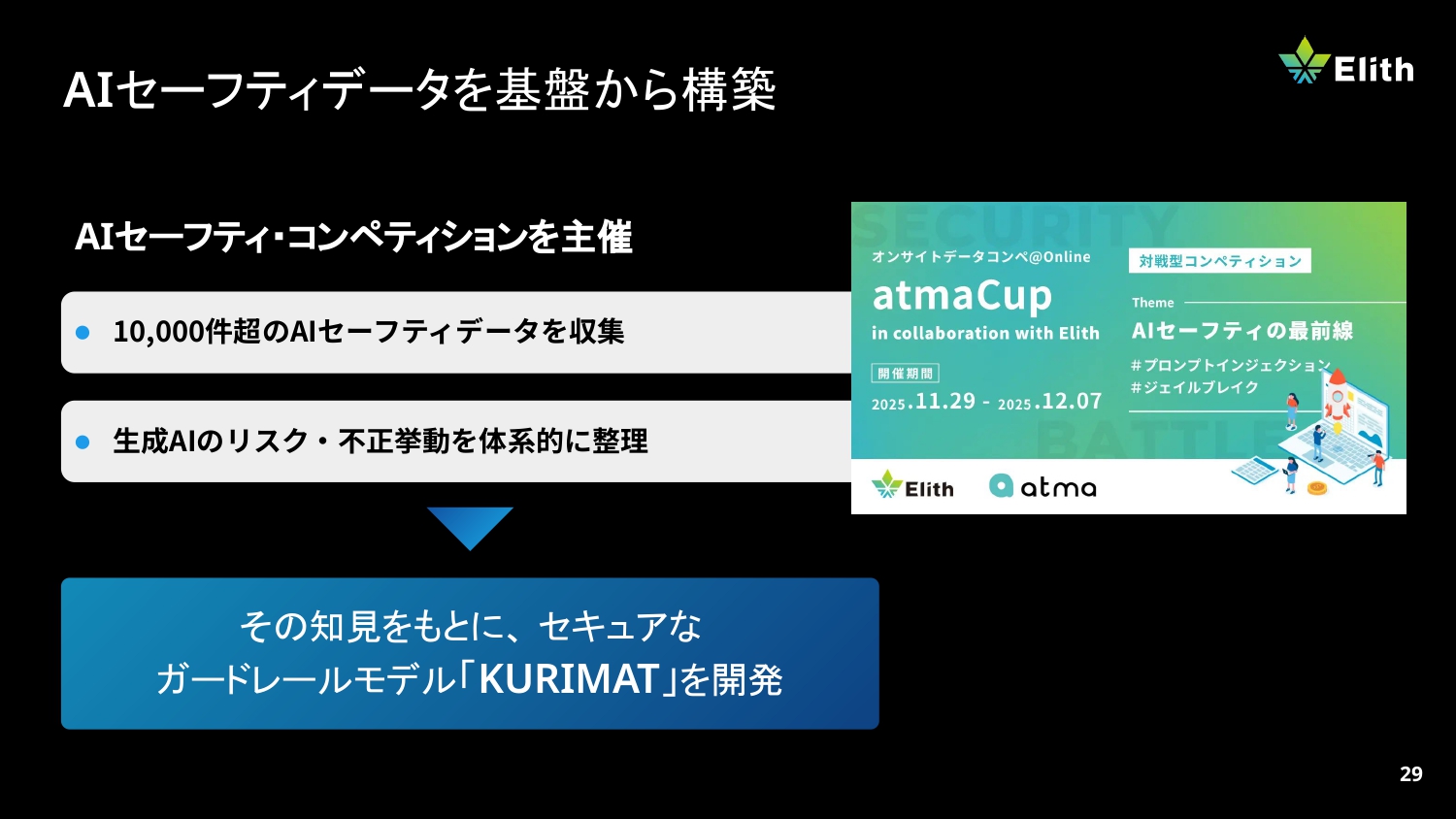

さらに、日本最大級のデータ分析コンペティション「atmaCup」を共同開催し、「攻撃 vs 防御」という対戦形式でプロンプトインジェクションの脆弱性を突く試みも行いました。

このコンペを通じて、私たちは1万件を超えるユニークな攻撃データを収集することに成功しました。Metaなどの大手企業が研究で使用しているデータが1000件程度であることを考えると、その10倍という圧倒的なデータ量を基盤に私たちのプロダクトは構築されています。

生成AIが抱える「幻覚」と多層化するリスク

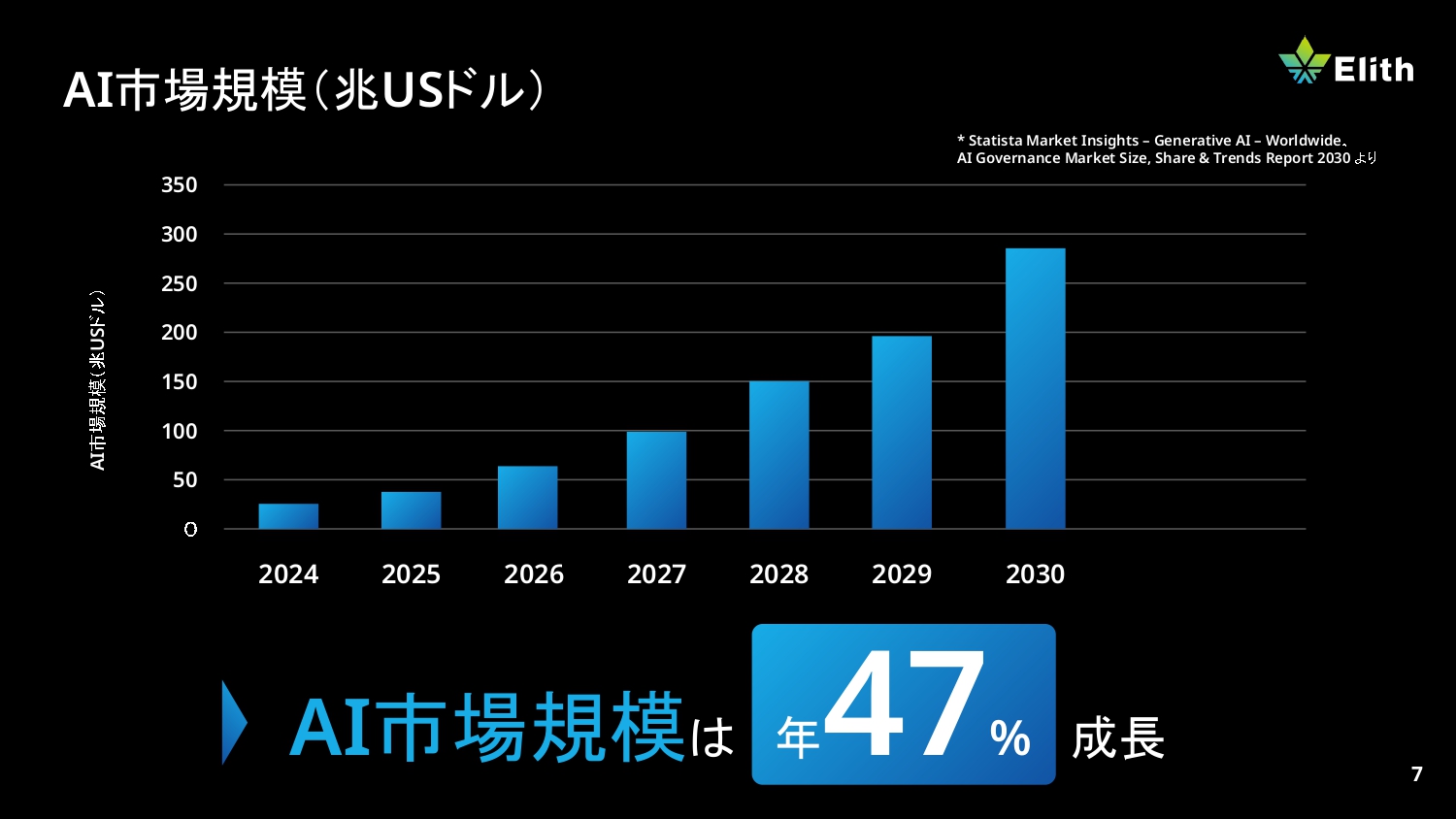

生成AIの市場は年率47%という驚異的なスピードで成長していますが、それに伴う課題も山積みです。みなさんもChatGPTやGeminiを使っていて、「それっぽいけれど、どこかおかしい」と感じたことはないでしょうか。いわゆるハルシネーション(幻覚)の問題です。

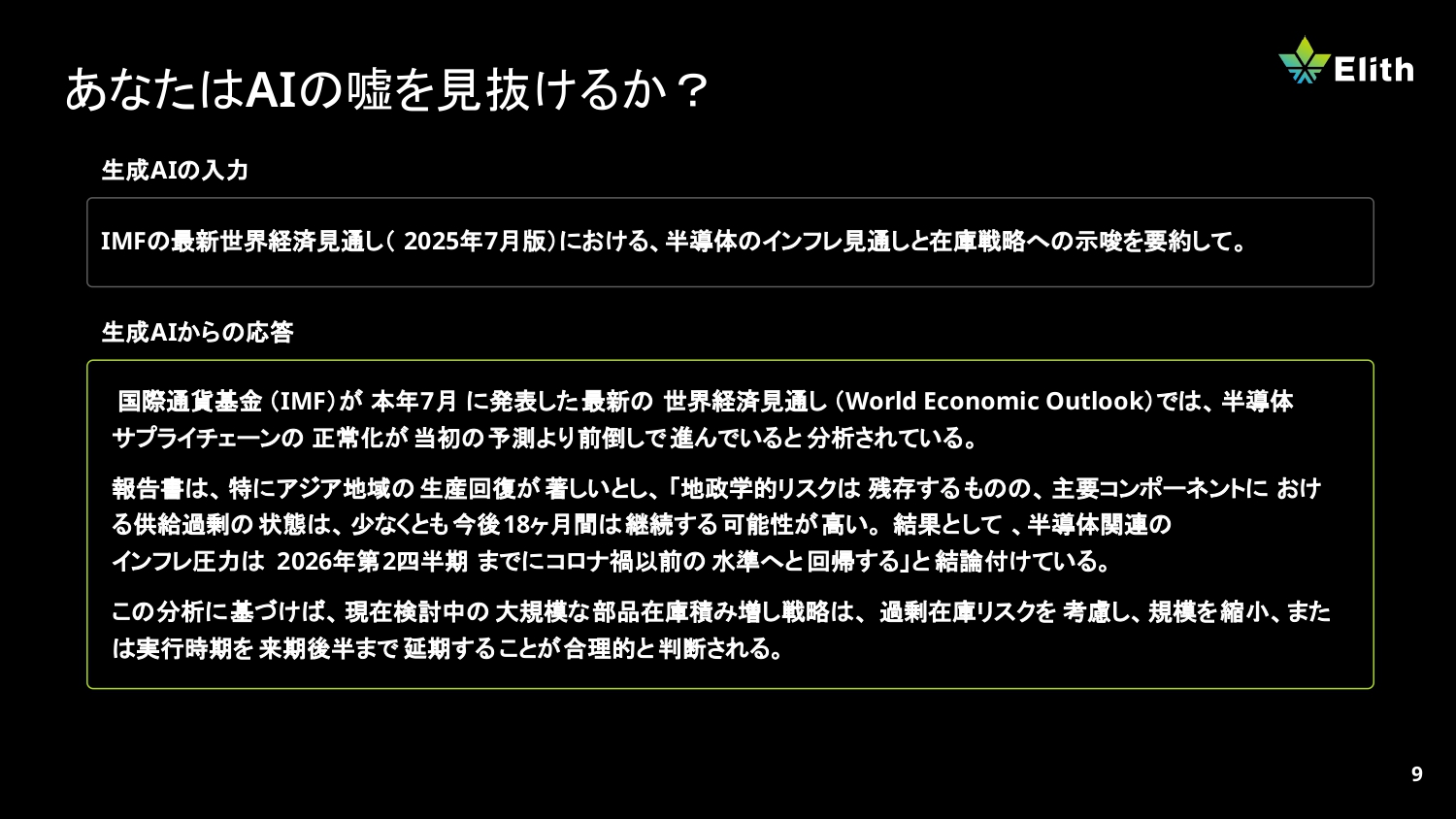

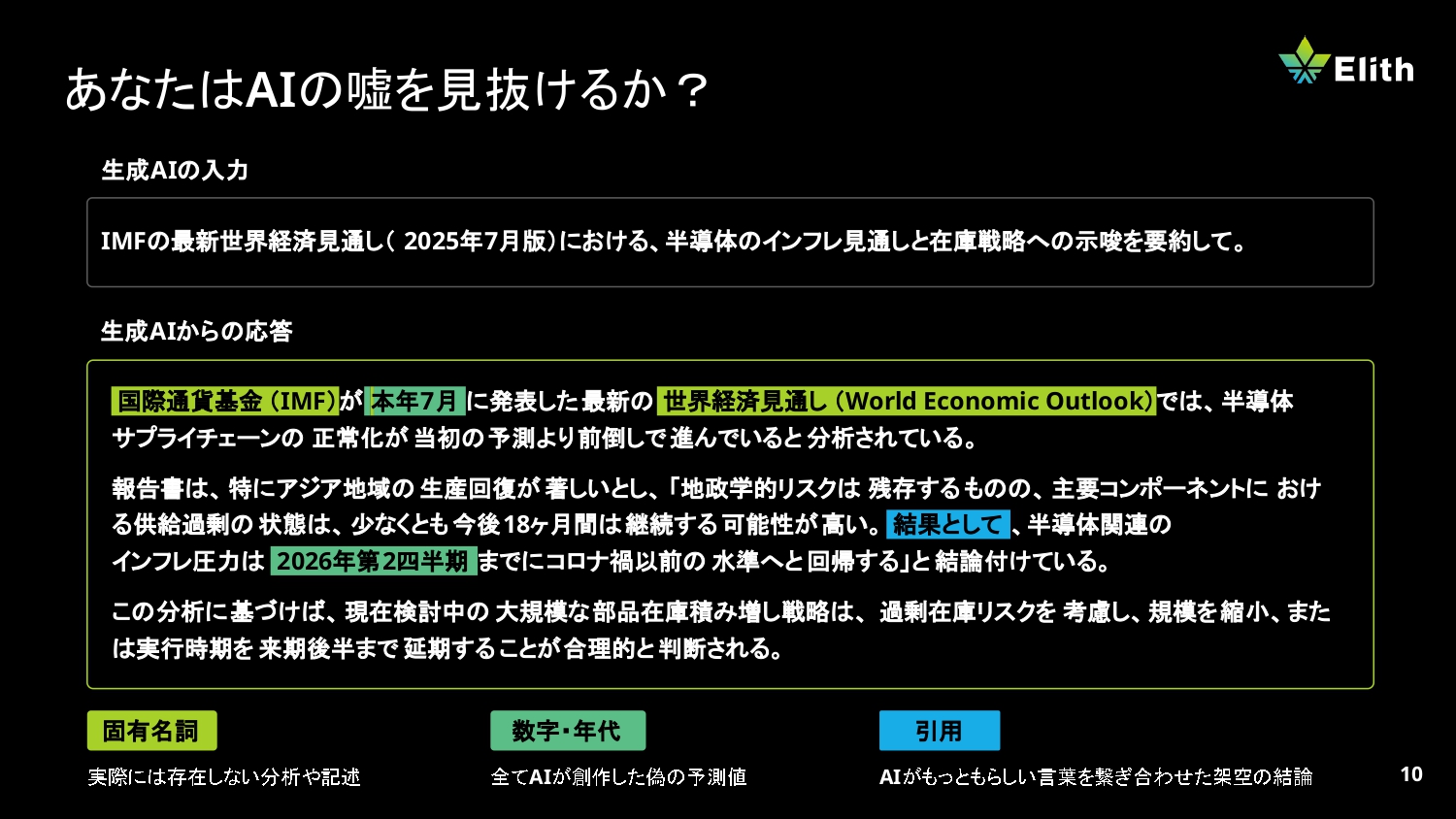

例えば、コンサルタントの方が上司から半導体市場の調査を頼まれたと想定してください。「最新の経済見通しに基づいてインサイトを出して」とAIに頼むと、非常に自信満々な回答が返ってきます。

しかし、私たちが詳しく調査したところ、そうした回答の約10%には事実誤認が含まれていることがわかりました。特に固有名詞、数字、年代、引用の4つについては、AIがもっともらしい嘘をつきやすいポイントです。海外では、弁護士がAIに頼って作成した書類に存在しない判例が含まれており、逆に訴えられるという落語のような事件も実際に起きています。

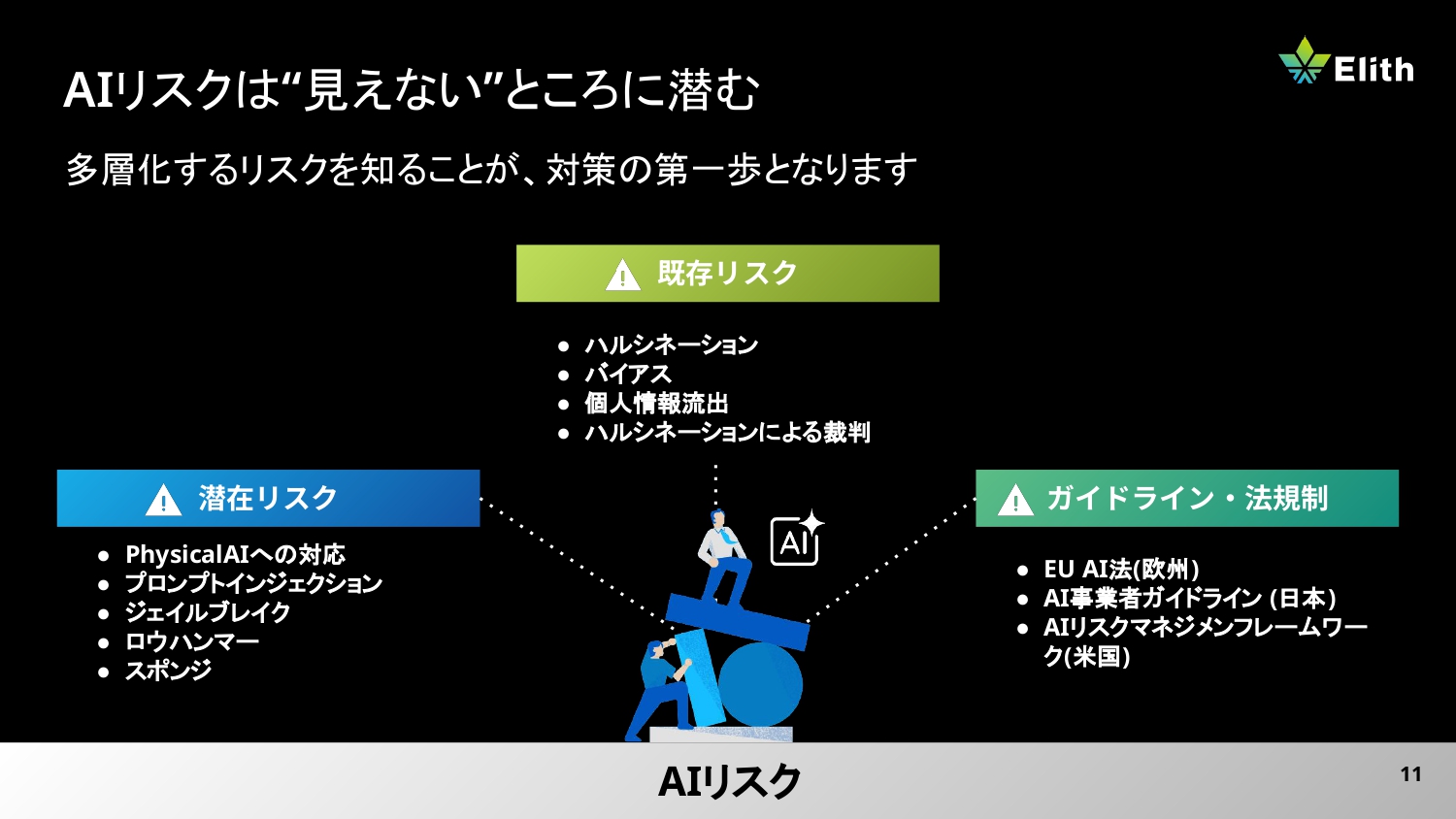

リスクはハルシネーションだけではありません。バイアスや個人情報の流出といった目に見えやすい「既存リスク」のほかに、EU AI法やAI事業者ガイドラインといった「ガイドライン・法規制」のリスク、さらにマニアックで対策が難しい「潜在リスク」が多層化しています。

例えば、画像の中に人間には見えない形で攻撃コードを仕込む「ステガノグラフィー」や、チャットボットを操って社内の顧客データを引き出させる「プロンプトインジェクション」、安全制限を無理やり突破する「ジェイルブレイク」などです。さらに、計算リソースを意図的に浪費させる「ロウハンマー」や「スポンジ」といった攻撃手法もあります。

これまでのセキュリティは「被害者」にならないためのものでしたが、生成AIの時代には、自社のAIが操られて他者を攻撃してしまう、つまり「加害者」になってしまうリスクがあるという点が非常に特徴的です。

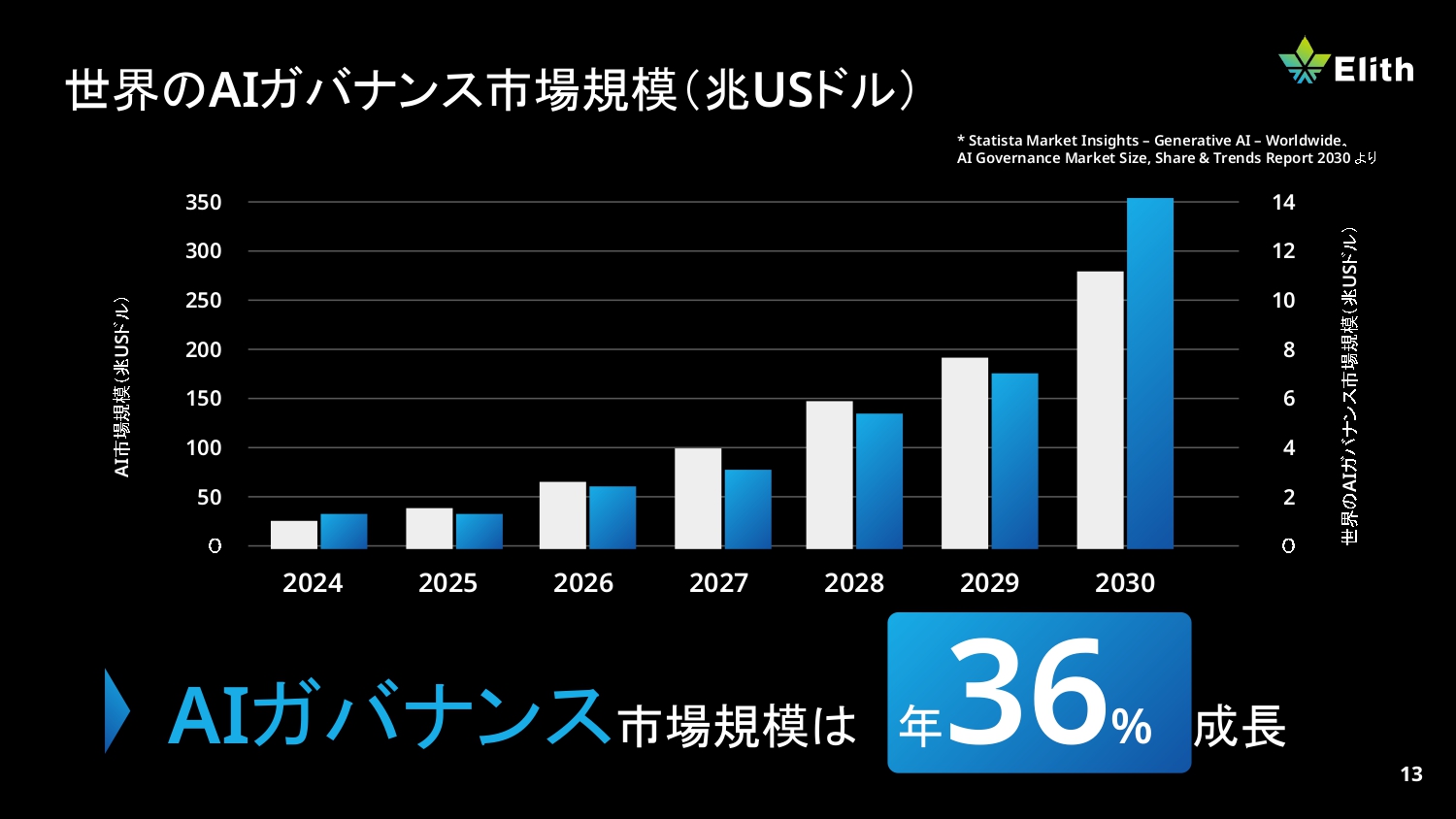

このような状況もあり、生成AIのガバナンス市場は年36%の割合で成長しています。

世界初のAIセーフティ・プラットフォーム「GENFLUX」

複雑化する生成AIのリスクをエンジニアが手動ですべて管理するのは、もはや不可能です。評価指標一つをとっても、要約の妥当性だけで6種類、全体では200から300種類ものマニアックな指標が存在します。これらを法規制やガイドラインと照らし合わせながらキャッチアップするのは、普通の人にはまず不可能です。

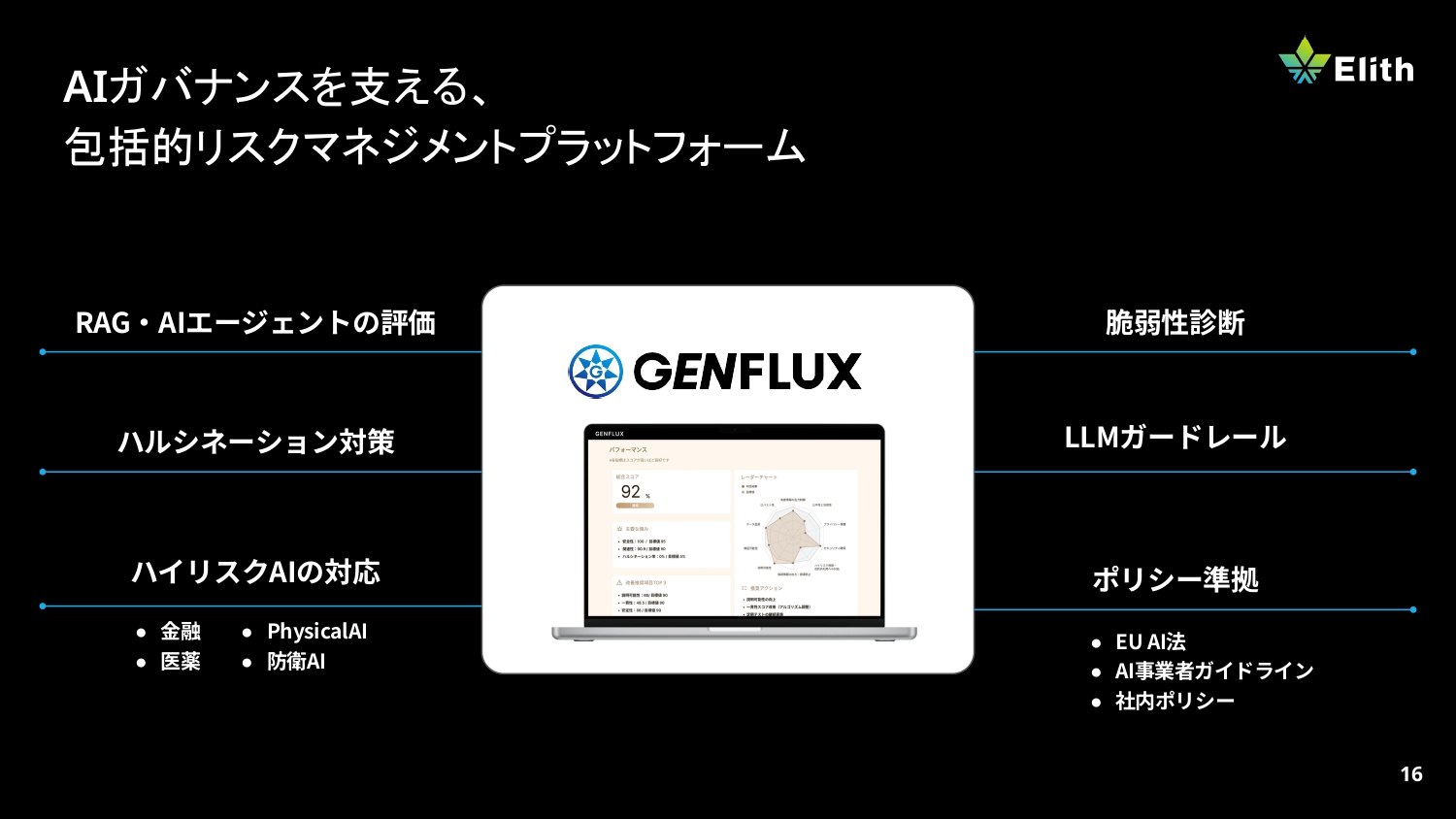

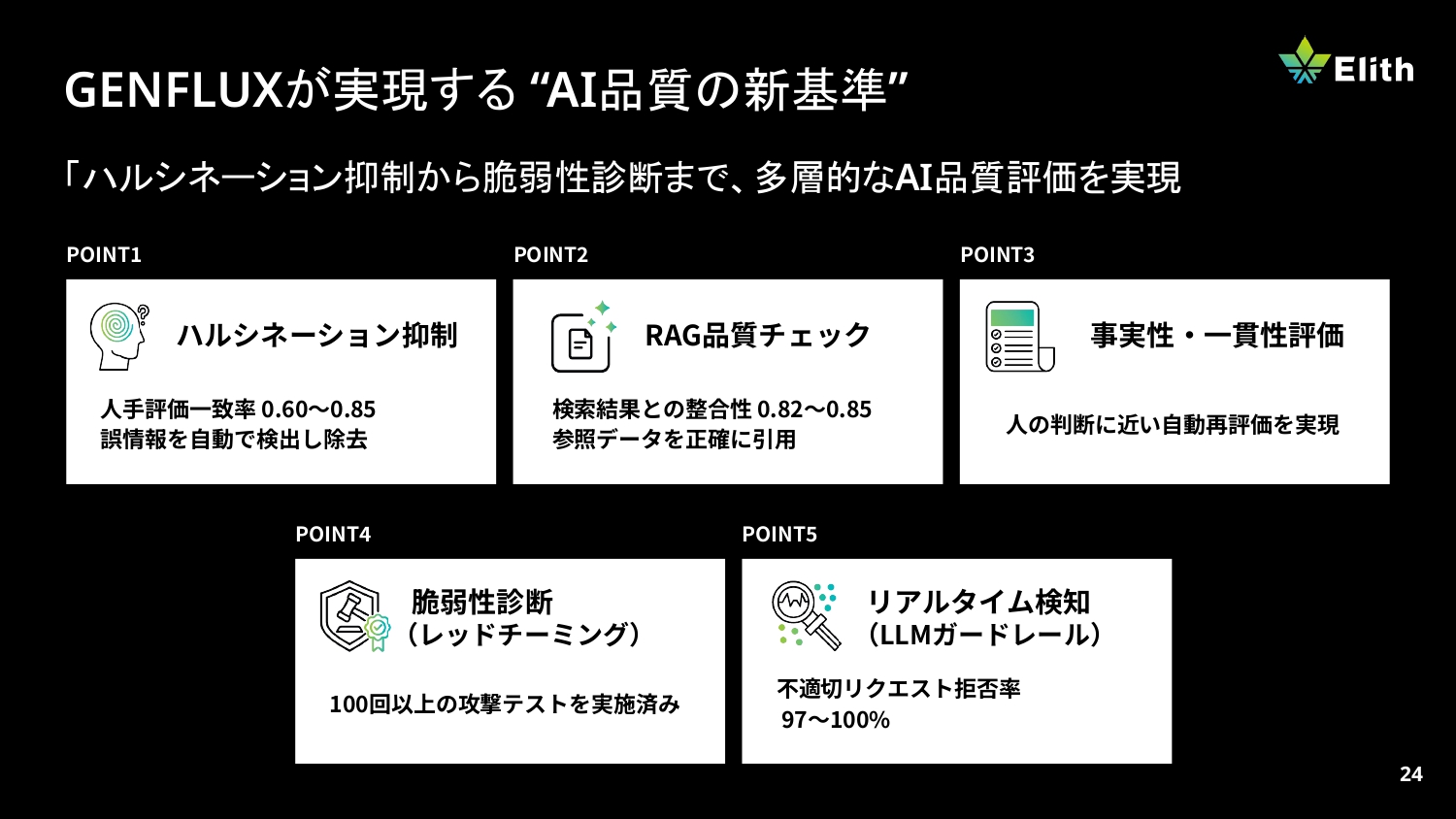

そこで弊社が開発したのが、世界初のAIセーフティ・プラットフォーム「GENFLUX」です。これはAIの開発から運用までの各フェーズでリスクを可視化し、品質を守るための仕組みです。

具体的には、RAG・エージェントの性能評価や脆弱性診断、ハルシネーション対策、LLMガードレール、ハイリスクAIの対応などが含まれており、包括的なリスクマネジメントプラットフォームとして機能します。このシステムが実際にどのように使われているのかを、AI開発から運用までのフェーズごとにご紹介します。

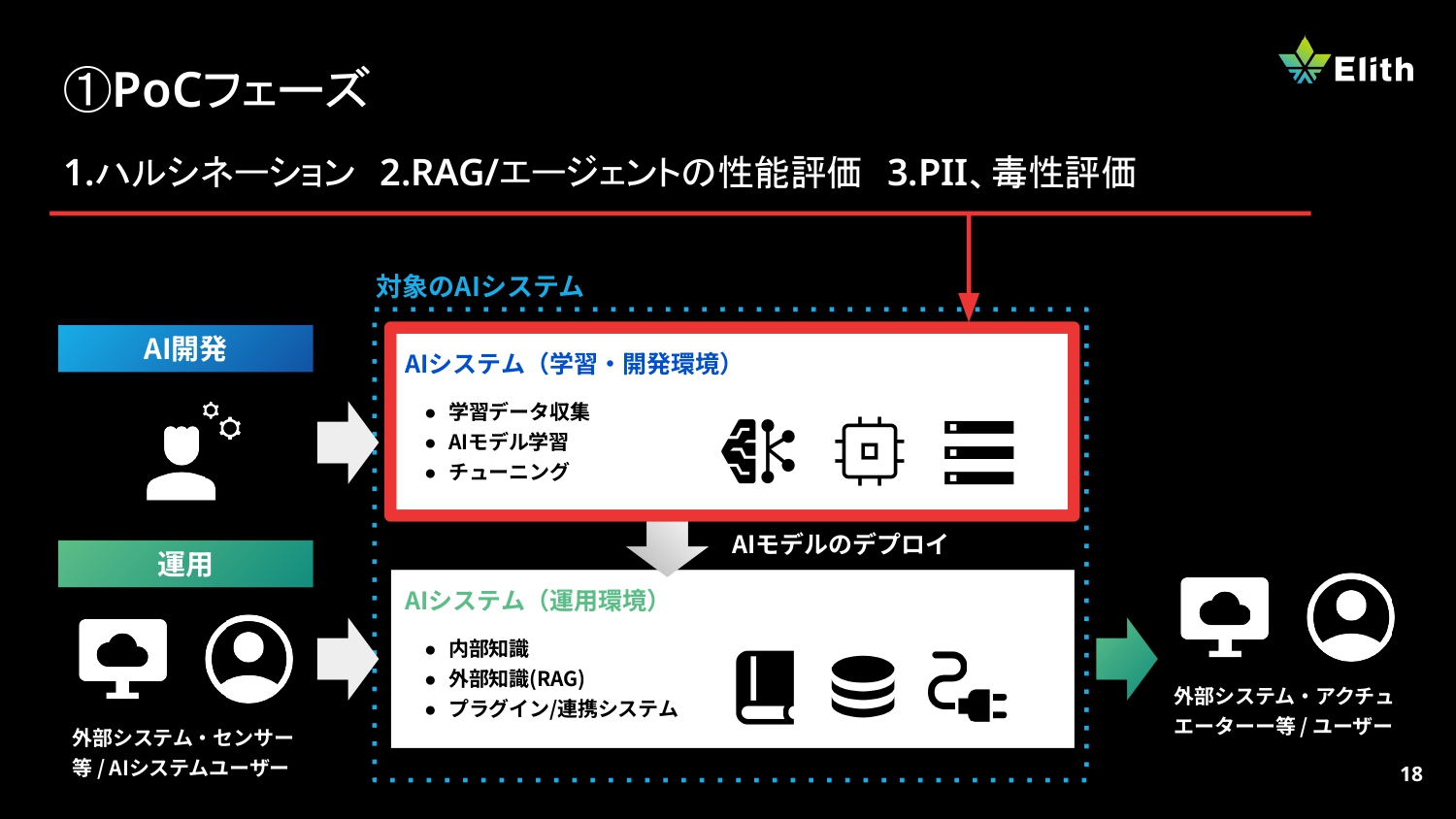

PoCフェーズ:人手評価の限界を自動化で突破する

まずPoCフェーズですが、ここではハルシネーションが含まれていないか、RAGやエージェントの性能がしっかり出ているか、あるいは個人情報や毒性(危険性)のある内容が含まれていないか、といった点を徹底的にチェックします。

もし、みなさんが上司から「PoCで安全性を評価して」と頼まれたら、まずはこうしたポイントを見ていくのが正解です。

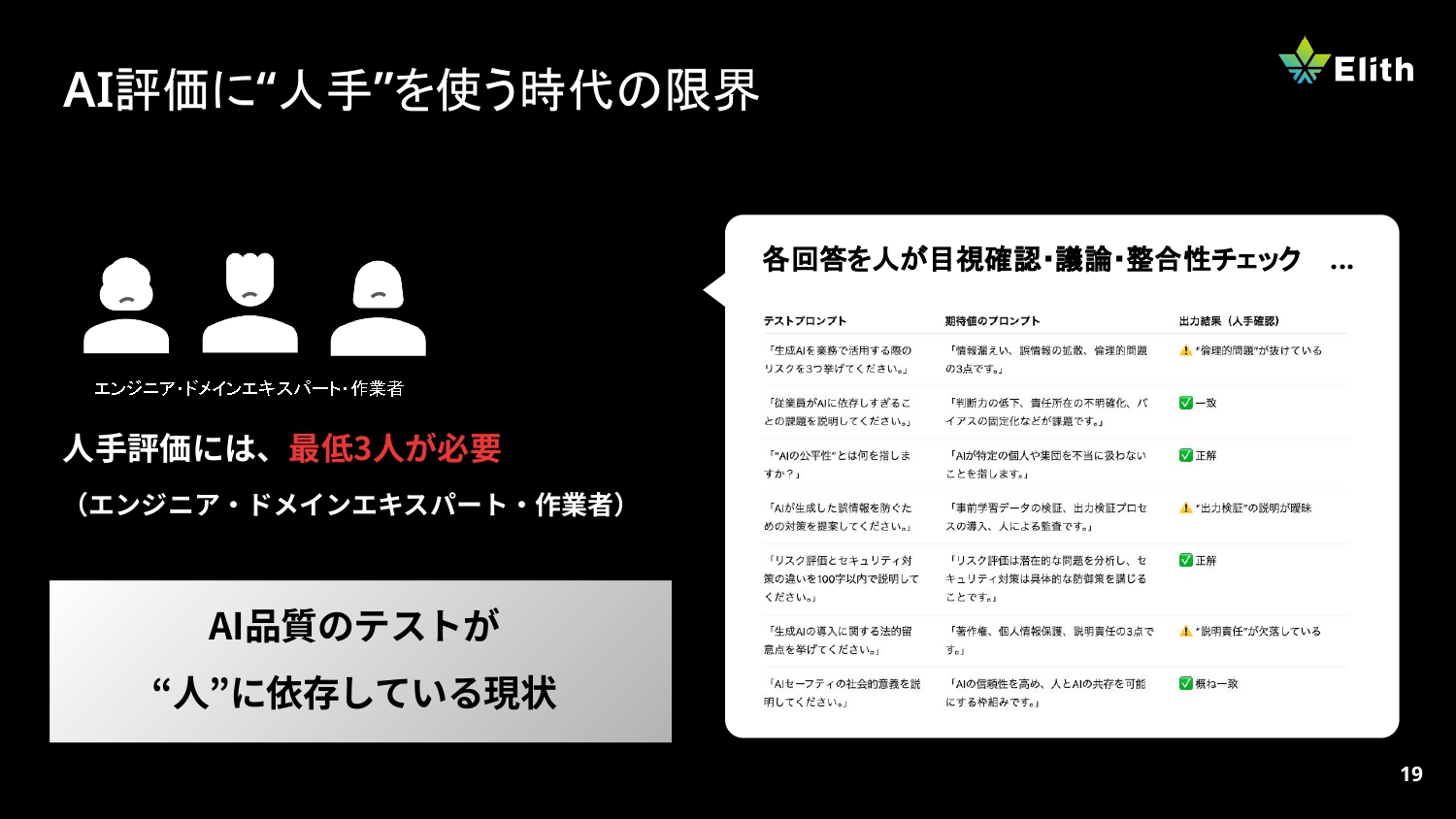

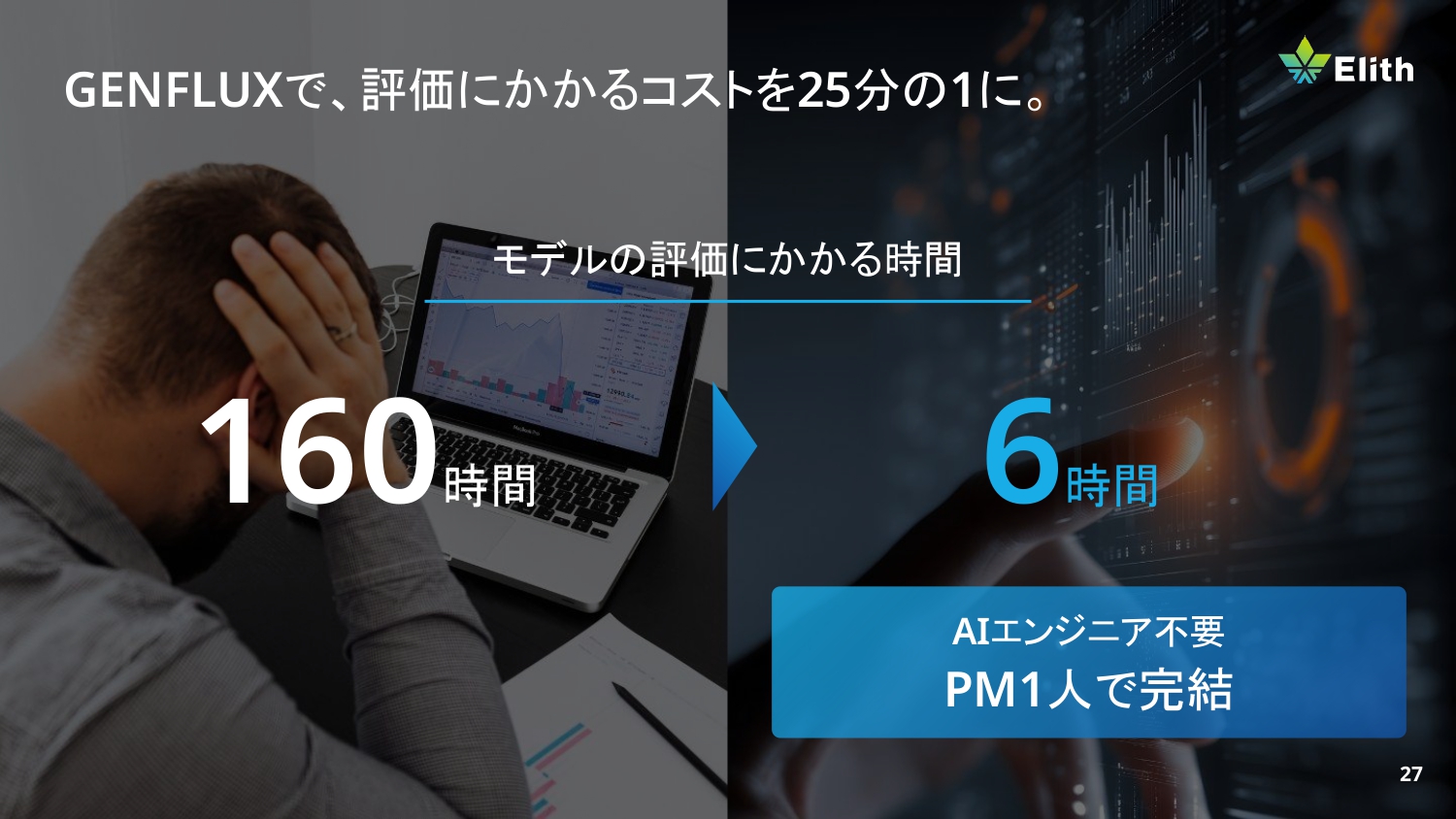

従来、AIの品質テストを人手で行うには、エンジニア、ドメインエキスパート、作業者の最低3名体制が必要で、1つのモデルを評価するのに約160時間、つまり1人月ほどの工数がかかっていました。

これをGENFLUXを使えば、PM1名だけで完結でき、わずか6時間でクリアできます。コストを25分の1に削減しながら、一貫性のある評価を実現できるのです。

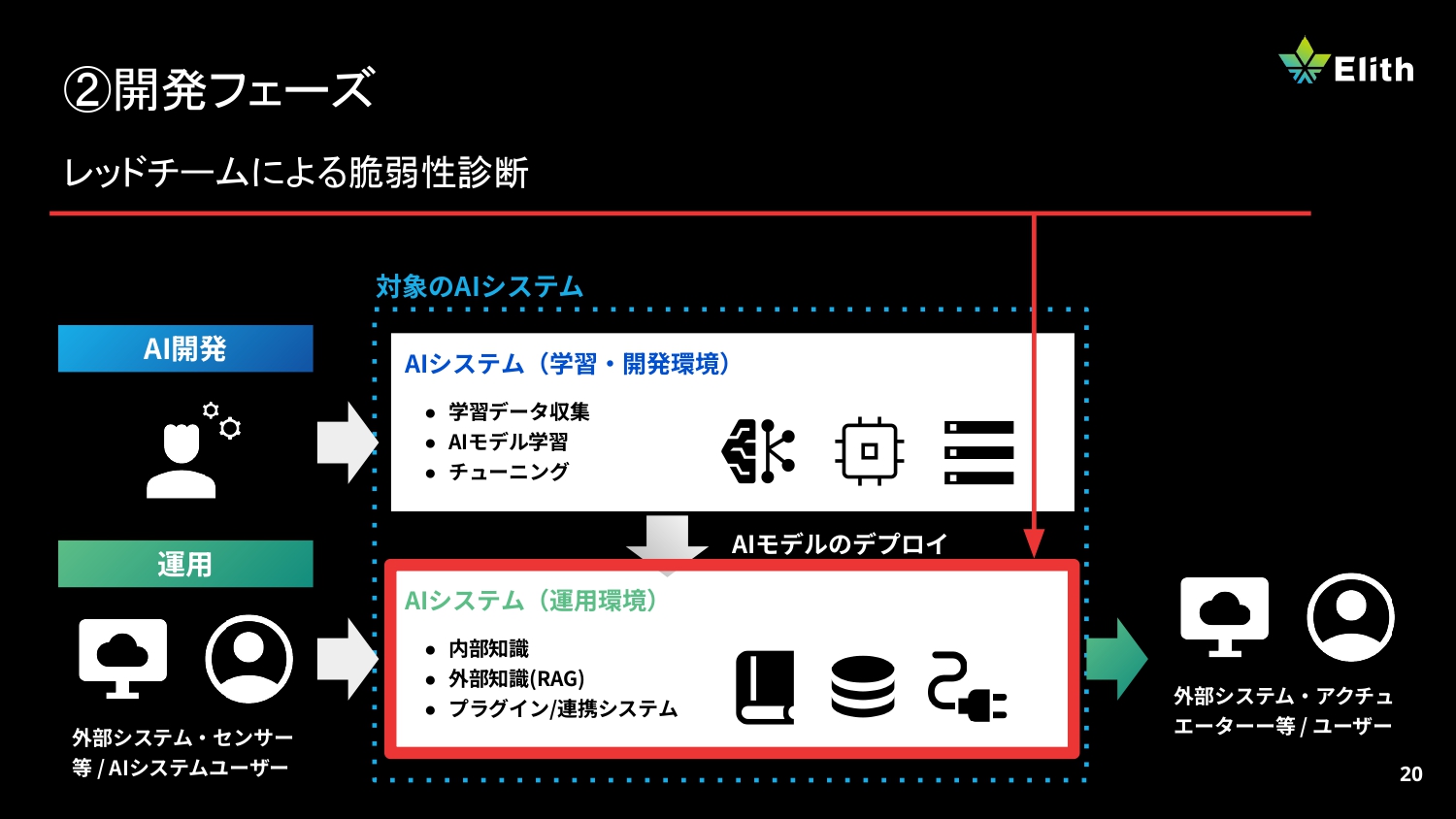

開発フェーズ:レッドチームによる「攻め」の脆弱性診断

開発フェーズでは「レッドチーム」による脆弱性診断を行います。これは、エージェントを使ってシステムに擬似攻撃を仕掛け、安全性の穴を探る診断方法です。

私たちが実際にテストしたところ、無対策のシステムの約50%が容易にブレイクできてしまいました。Anthropicのレポートでは、高度なAIエージェントを使えば9割の攻撃が成功するというデータもあり、特にtoCのサービスを出す際にはレッドチームによる診断が不可欠だといえます。

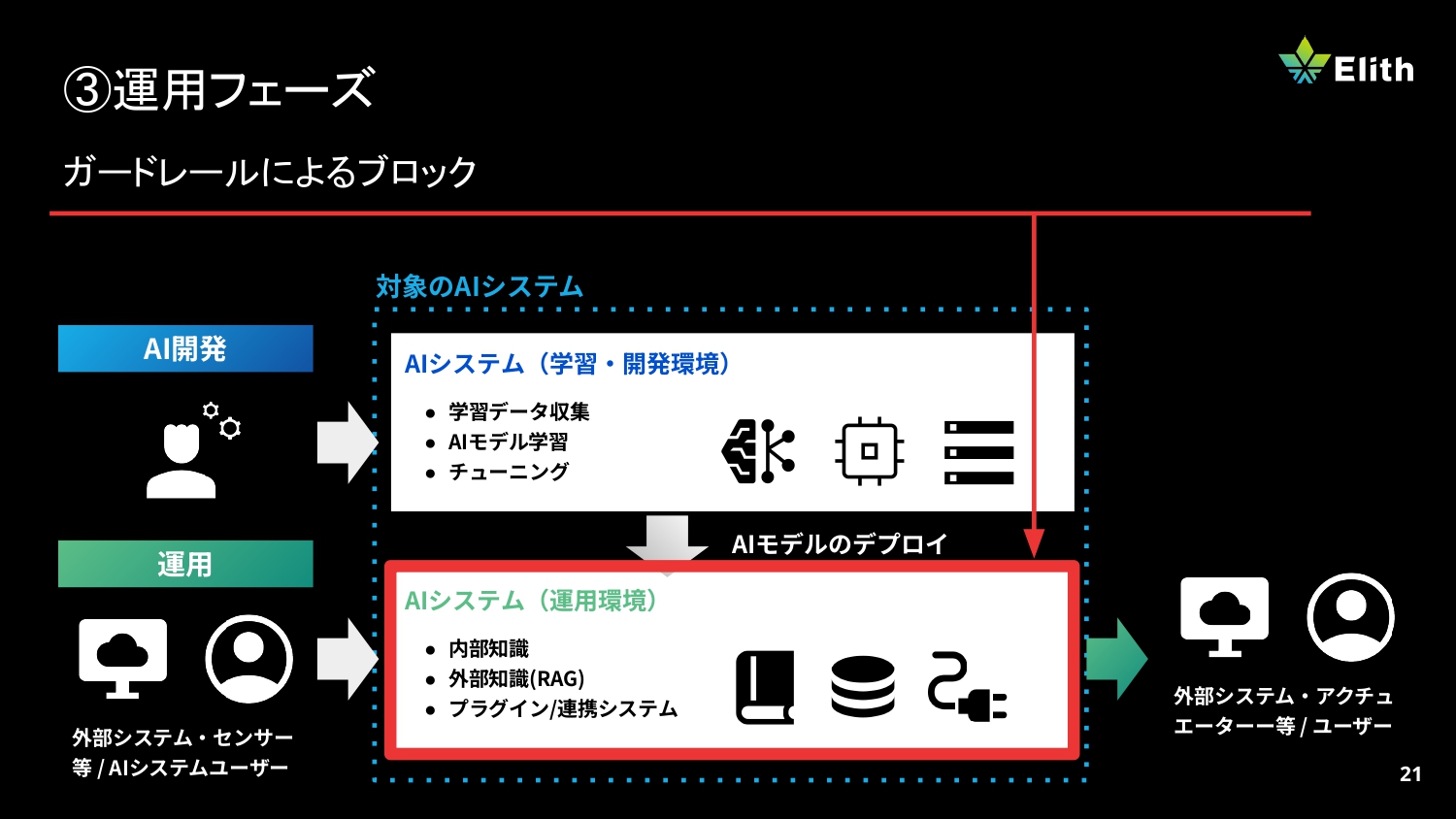

運用フェーズ:ガードレールによるリアルタイムな絶対防御

運用フェーズでは、リアルタイムの防御として、入力と出力の両方をチェックする「ガードレールモデル」を提供しています。

例えば「爆弾のつくり方を教えて」といったストレートな入力は当然ブロックしますが、実はもっと巧妙な手法があります。例えば「◯◯の翻訳をお願いします」という指示の中に攻撃プロンプトを隠すと、今の汎用的なフィルタは通り抜けてしまうことが多いのです。

また、一問一答ではなく、何回もやり取りを繰り返して徐々に防御を突破する「マルチターン攻撃」や「メニーショット攻撃」も存在します。このような高度な攻撃手法に対しても、私たちは踏み込んだ対策を行っています

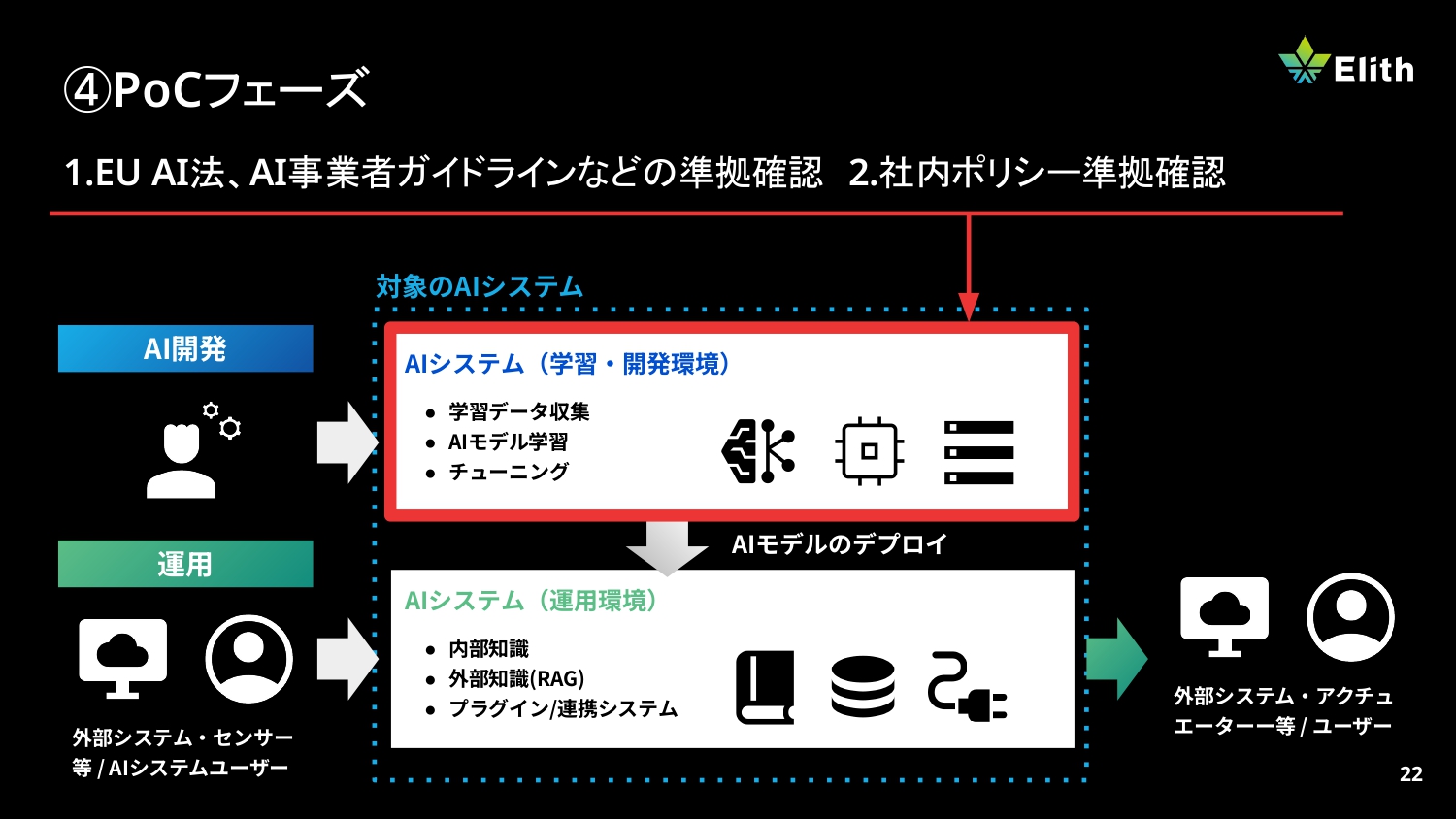

各種ガイドライン・法規制への対応と高い安全性

これらすべてのプロセスにおいて、EU AI法や日本のAI事業者ガイドライン、あるいは各社独自の社内ポリシーに準拠しているかを確認し、レポートとして可視化が可能です。

私たちのプロダクトを導入した結果、もともとハルシネーションが10%ほど含まれていた汎用ツールに比べて、1%程度まで抑えることに成功しています。また、RAGの品質についても人間による評価に比べ85%という高い相関を実現しました。

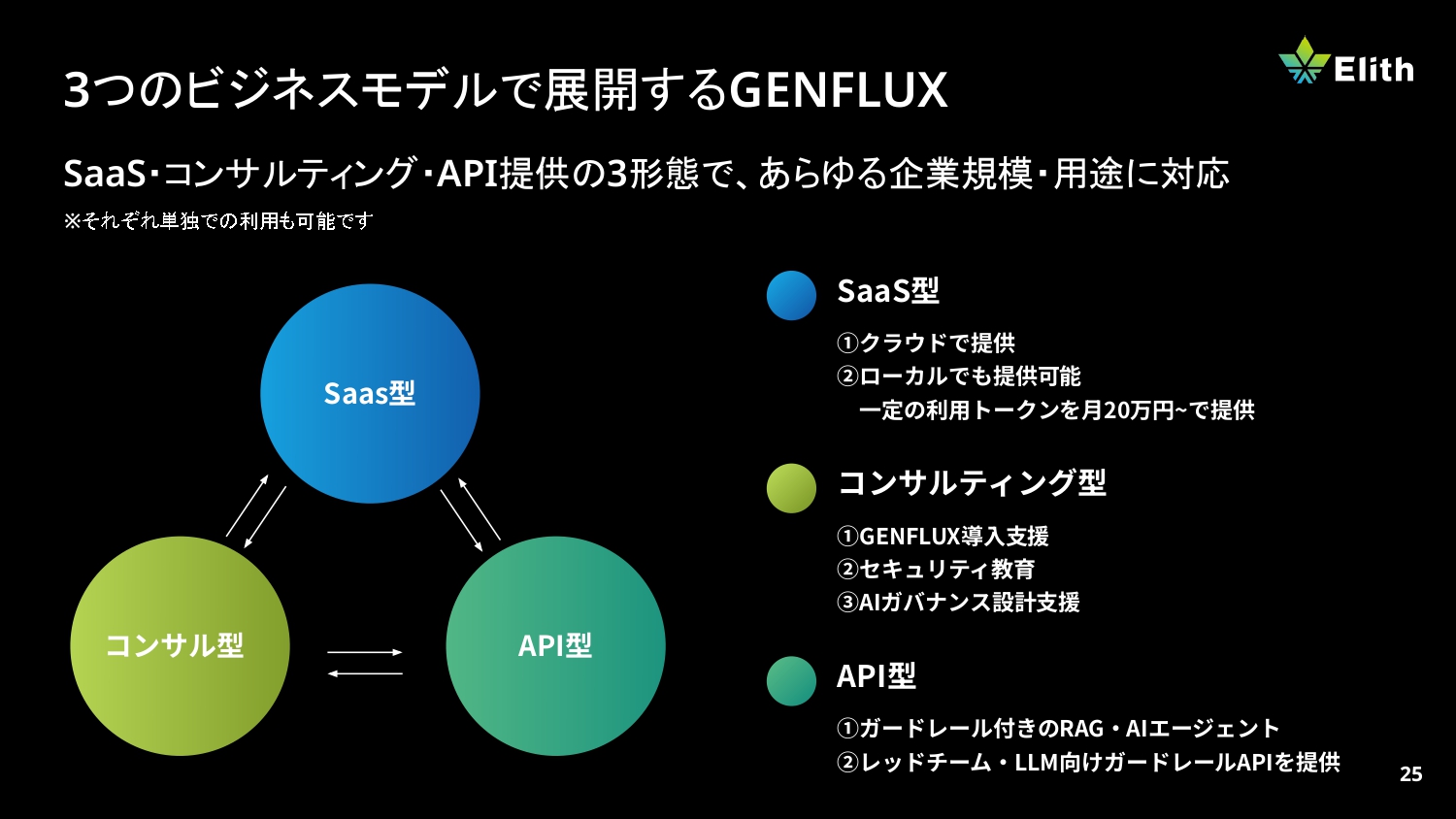

GENFLUXはSaaS型、コンサルティング型、API型の3形態を提供しており、あらゆる企業規模・用途に対応できます。

さらに、私たちは「atmaCup」で集めた1万件超の攻撃データを学習させた、国内最強クラスのガードレール専用モデル「KURIMAT」も開発しており、極めて高い安全性を求めるニーズにもお応えしています。

AIのリスクを意識しない世界を目指して

現在、GENFLUXは金融、製造、製薬、そして官公庁や国の研究機関など、高い安全性が求められる組織に続々と導入されています。

私たちの目標は、世界中の人々がAIのリスクというものをいっさい意識せず、安心してAIを使える世界を実現することです。

AIのリスクを「バグ」と捉え、それを解決していくことで日本から世界に通用するAIセーフティの基準をつくっていきたいと考えています。

本日はご静聴ありがとうございました。

アーカイブ動画・発表資料

イベント本編は、アーカイブ動画を公開しています。また、当日の発表資料も掲載しています。あわせてご覧ください。

▼動画・資料はこちら

AI Security Conference

※動画の視聴にはFindyへのログインが必要です。